近い将来、コンピュータのAIが我々よりもはるかに賢くなり、AIが私たちのあらゆる仕事と資源を奪い、そして人類は絶滅してしまうかもしれないという話を聞きました。本当でしょうか? これは、私がAIについて話をする時、最も頻繁に受ける質問である。質問者たちは真剣だ。部分的には、彼らの不安は同様の疑念を抱いている専門家もいるということから生じている。AIに懸念を抱く人々は、現代における最高の知識人たちも含まれている。たとえば、スティーブン・ホーキング、イーロン・マスク、マックス・テグマーク、サム・ハリスやビル・ゲイツといった人たちであり、彼らはこのシナリオが本当である可能性は非常に高いと信じている。最近では、AI問題の議論のために招集されたカンファレンスで、AIに最も精通した導師である9人のパネリストたちは、超人的知能は不可避であり、そう遠くない将来のことであるとして意見が一致した。

けれども、この超人的な人工知能による支配シナリオの根底には、5つの仮定が含まれている。それらの仮定は、注意深く検討してみるといかなる根拠にも基いていない。これらの主張は、将来においては真となるかもしれないが、現時点では支持する根拠は存在しないものである。超人的知能がすぐに出現するという主張の裏にある仮定は、以下の通りである:

- 人工知能は、既に我々より賢くなっている。指数関数的な速度で。

- 我々は、AIを汎用目的知能にすることができる。我々と同じく。

- 人間の知能はシリコン上で作成できる。

- 知能は無限に拡大できる。

- ひとたび、爆発的に進歩する超知能を作成できれば、超知能は問題のほとんどを解決できる。

上記の正統な信仰信条とは反対に、次の5つの異端説を支持する根拠は多数存在すると思う。

- 知能は単一の次元ではない。ゆえに「人間より賢い」という概念には意味が無い。

- 人間は汎用知能を持っていない。AIも同様に汎用知能を持たないだろう。

- 人間の思考を他の媒体で再現することは、コストによって制約されるだろう。

- 知能の次元は無限ではない。

- 知能は進歩における一要素でしかない。

もしも、超人的人工知能の支配という予想が、何ら根拠を持たない5つの仮定の上に建てられているのだとしたら、この考えは宗教的な信念と同種のものであるということになる。--すなわち、神話である。次の段落からは、私の反論5件それぞれの根拠を説明しようと思う。そして、超人的人工知能は、実際のところ神話の一種であると証明したい。

1.

人工知能に関する最もありふれた誤った概念は、天然知能に対する典型的な誤解から生じているものである。この誤解とは、知能とは一次元の量であるというものだ。テクノロジーに精通した人たちは、知能を、文字通り、単一の次元で単線的に増大する量としてグラフに表現する場合が多い。ニック・ボストロムが著書『スーパーインテリジェンス』の中で表現したように。知能の階層の末端には、微小生物が位置している。逆側の先端には、高い知能を持つ人、いわば天才が位置している。ここでは、知能の量が、ちょうど音量をデシベルで測定するかのように表現されている。当然、この場合は知能の「音量」増大が継続されると想像するのは簡単であり、最終的には、我々自身の高い知能を超えて、「超大音量の」知能となり --轟音!-- 人間を超え、グラフからもはみ出してしまうかもしれない。

このモデルは、トポロジー的に梯子と等しい。つまり、知能の梯子のそれぞれのステップは、前のステップよりも1段階高いところにある。下等生物は我々よりも低いところに位置し、一方、高いレベルの知能を持つAIは必然的に人類より高いステップに位置するであろう。それがいつ起きるかというタイムスケールは問題ではない。重要なのはランキングだ。--増加していく知能の値である。

このモデルの問題点は、進化の梯子と同じように神話的であるということだ。ダーウィン以前の自然観においては、生物には階梯が存在すると信じられていた。下等生物は、人間よりも下に位置するとされていたのである。ダーウィン後の時代でさえ、進化を「梯子」であると見なす考え方は極めてありふれている。魚類が進歩して爬虫類となり、その後哺乳類へと進歩し、霊長類、そして人間へと。それぞれの段階では、以前の存在よりも少しだけ進化している(そして当然賢い)と考えられている。つまり、知能の梯子は生命の梯子と平行であると見なされている。ところが、このどちらのモデルも完全に非科学的な見方である。

生物種の自然進化を表現する正確な図は、ちょうどこのように外側へ拡大していく円盤として表されるものであろう。この図はテキサス大学のデヴィッド・ヒルズ教授が最初に作成したものであり、DNAの類縁関係に基いている。この深淵なる曼荼羅の系譜は、最央部の原始的生命体から開始し、時間の経過とともに外側へと枝分れしていく。時間は中心から外向きに流れていくため、今日地球上に存在する生物種は円盤の円周部分に位置している。この図が強調していることは、進化についての少し理解しがたい基本的な事実である。すなわち、今日生きているあらゆる生物種は、みんな等しく進化しているのである。人間は、ゴキブリ、二枚貝、シダ植物、キツネやバクテリアと並んで円の外周部に位置する。これら全ての種は、30億年に渡る途切れることのない成功した生殖の連鎖をなしている。それゆえ、今日のバクテリアやゴキブリは、人間と同様に高度に進化していることを意味する。そこには梯子は存在しない。

同様に、知能の梯子も存在しない。知能は単一の次元ではなく、たくさんのタイプとモードを持つ認知能力の複雑な組み合わせであり、それぞれが連続したつながりをなしている。動物の知能測定という単純なタスクを考えよう。もしも知能が単一の次元であるならば、オウム、イルカ、馬、リス、タコ、クジラ、猫とゴリラを、知能の高さに従って順番に並べられるだろう。現在のところ、そのような序列の存在を示す科学的な根拠はない。動物の知能に差異がないことがその理由かもしれない。けれども、そうであるとも考えにくい。動物学には、動物たちの思考方法が顕著に異なることを示す事例がたくさん存在している。それでは、あらゆる動物種は同一の相対的「汎用知能」を持っているのだろうか? 可能性はあるが、そんな汎用知能を表す単一の単位や測定手法は存在しない。そうではなく、たくさんの種類の認知能力に対して、たくさんの異なった種類の指標が存在しているのだ。

単一の「デシベル」直線よりも正確な知能のモデルは、その可能性の空間として描くものであろう。ちょうど、上図の通り、リチャード・ドーキンスのアルゴリズムによって描かれた、ありうる形状を描写した図のように。知能は組み合わせの連続体である。複数のノードが存在し、それぞれのノードは連続体である。それら複数のノードが、高次元における大きな多様性を持つ複合体を創り出している。ある知能は非常に複雑で、複数の思考の下位ノードを持っているかもしれない。別の知能はそれより単純であるものの強力であり、知能空間の先端に位置するかもしれない。我々が知能と呼ぶこれら複合体は、たくさんの種類の楽器で奏でられるシンフォニーとして捉えられるのではないだろうか。それぞれの楽器の音量が異なるだけではない。ピッチ、メロディー、音色、テンポ、なども違うのである。知能とは、エコシステムとして考えることができるだろう。そしてこの意味において、思考ノードの異なる要素は互いに依存し、互いを創りだしているのである。

人間の心とは、マーヴィン・ミンスキーが言う通り、心の社会である。我々は思考のエコシステムの上で駆動している。人間は、多数のタイプの考え方をする認知能力を、複数種類を保持している。たとえば、帰納、演繹、シンボリックな推論、感情的知能、空間論理、短期記憶と長期記憶、などだ。体内にある神経系全体も、独自の認知モードを備えた一種の脳なのである。我々は、実際のところ脳だけで考えているのではない。むしろ、身体全体で考えているのだ。

これらの認知能力の組み合わせは、個体間、生物種の間で異なっている。ある種のリスは数千個ものドングリの正確な場所を何年間も記憶することができ、その技能は人間の心よりも優れている。ゆえに、あるタイプの認知能力においては、リスは人間を超えている。その超知能は、リスとしての心を作り出すために、他の種類のモードと一緒にリスの中に組み込まれている。それゆえ、我々自身の心と比較すれば不明瞭にしか見えない。それ以外にも、動物界には特化した認知能力がたくさん存在しており、人間よりも優れているものもある。そしてもう一度言えば、それらの超知能は異なるシステムに組み込まれているものである。

AIも同様である。人工の心は、ある次元においては既に人間を超えている。電卓は数学の天才だ。Google検索の記憶力は、ある次元においては既に我々自身の記憶を超えている。我々はAIをエンジニアリングし、特定のモードにおいて優れているように作り上げる。あるモードについては我々にも可能なことが含まれているが、人工知能のほうが得意なものもある。たとえば、確率や数学などだ。他のタイプの思考には、我々が全くできないこともある。-- どんな検索エンジンであっても、60億のウェブページ上のあらゆる単語を記憶できる。将来、新しい認知能力のモードが発明されるだろうが、それは我々の中に存在せず、自然界のどこにも存在しないだろう。人間が「人工飛行」を発明しようとしたとき、初めは生物的な飛行モードから発想を得ていた。主に、羽ばたく翼である。しかし、実際に人間が発明した飛行方法 -- 広い固定翼に接続されたプロペラ -- は、我々の生物世界では知られていない、新種の飛行モードであった。同様に、人間は自然界に存在しない、完全に新種の思考モードを発明するだろう。多くの場合、それらは新しく、狭く、「小さく」、特定の機能に向けた特定のモードになるだろう。 -- おそらく、統計や確率においてのみ有用な種類の推論かもしれない。

あるいは別の場合には、新しい心は複合タイプの認知能力となるかもしれない。それを使って、我々自身の知能のみでは解決不可能な問題を解決するのである。ビジネスや科学における最も困難な問題は、2ステップの解決策を必要とする場合がある。ステップ1は、我々の心と一緒に働く新たな思考モードを発明する。ステップ2、問題解決のためにそれらを統合する。我々は、以前は解決不可能だった問題を解決していくため、新たな認知能力を我々より「賢い」と呼びたくなるかもしれない。しかし、実際のところ、それは我々とは異なっているのである。考え方におけるこの差異こそが、AIの大きな利点である。私が思うに、妥当なAIのモデルはエイリアン的な知能 (または人工エイリアン) と捉えることだと思う。このエイリアン性こそが主要な資産なのだ。

同時に、これら多様なモードの認知能力は、より複雑で複合的な心の社会へと統合される。これらの複合体の中には、我々自身よりも複雑なものもあるだろう。そして、我々には解決できない問題を解くことができるため、この複合体を超人的AIと呼びたくなるかもしれない。しかし、いくらGoogle検索の記憶が人間を超えているからといって、Googleを超人的AIとは呼ばないだろう。なぜならば、Googleよりも我々がうまくできることはいくらでもあるからだ。これら人工知能の複合体は、多数の次元において我々を超えた能力を持つことは確かであろう。しかし、単一の人工知能の実体のどれ1つとして、我々ができること全てを上手く遂行できるわけではない。たとえて言うなら、人間の身体的能力と同様である。産業革命には200年の歴史があり、あらゆる機械全体の集合は、人間個人の身体的なアチーブメント (走行速度、重量上げ、加工の精度など) を超えているものの、平均的人間1人が可能なこと全てにおいて人間に勝る機械は存在しない。

AIの心の社会はより複雑になるだろうといえど、現在のところ、その複雑性の科学的な測定は難しい。複雑性を測定する操作的な指標は存在せず、キュウリとボーイング747のどちらが複雑であるのか、あるいは複雑さのあり方が異なるのかは判定できない。またこれが、賢さを測る妥当な単位を定義できない理由の1つでもある。心Aが心Bよりも複雑であるかを検証することは、非常に困難であるだろう。同様の理由により、心Aが心Bより賢いと言うのも難しい。もうすぐ、我々は「賢さ」が単一の次元ではないという明白な事実を認識するだろう。そして、本当に注目しなければならないのは、知能が動作する上での数多くの異なった方法であると気がつくはずだ。-- 我々が未だに発見していない、さまざまな種類の異なる認知能力のノードである。

2.

人間の知能に関する2つ目の誤りは、我々は汎用知能を持っているという信念である。この繰り返された信念が、よく言われるAI研究者の目標、つまり汎用人工知能 (AGI) の創造という目標に影響を与えている。ところが、もしも知能を大きな可能性の空間を与えるものとして捉えるならば、そこには汎用的な状態は存在しない。人間の知能が何らかの中心的な位置に存在し、特殊化した知能がその周りを回転しているというわけではない。実際は、人間の知能も非常に、非常に特化したタイプの知能であり、この惑星で我々の祖先が生き延びるために、何百万年もかけて進化してきたものなのである。人間タイプの知能を、知能の可能性の空間にマッピングしたとすれば、どこかの隅に位置して見えるだろう。我々の世界が広大な銀河の隅に位置するのと同様である。

確かに、万能のスイス・アーミーナイフ型の知能は想像できるし、実際に発明できるかもしれない。その種の万能知能は多くのことをうまくやってのけるだろうが、どれ一つとしてうまく遂行することはできないだろう。全ての物や生物と同様に、AIもまたエンジニアリングの根本原則に従うと考えられる。すなわち、あらゆる次元に対して最適化することは不可能であり、トレードオフだけが存在するということである。汎用的な多目的ユニットは、特化した機能を持つユニットに劣る。巨大な「あらゆることができる」心は、個々の機能に特化したエージェントと比較すれば、あらゆる能力において劣るだろう。我々は人間の心が汎用的であると信じているため、認知能力がエンジニアリングのトレードオフに従うことはないと思い込んでしまい、あらゆるモードの思考に最適化された知能を作成できると考えてしまう。けれども、そんな証拠はない。我々は、知能の空間全体を確認することができるような、十分な心のバリエーションを生み出してすらいない。 (そして、これまでのところ、我々は、動物の心もある次元においてさまざまな振幅を備えた特異なタイプの知能であるとは認めてこなかった傾向があるようだ)

3.

最大限の汎用目的思考という信念は、部分的には、万能計算 (ユニバーサル・コンピューテーション) の概念から生じているものである。1950年代にチャーチ=チューリングのテーゼとして示されたこの仮定は、ある閾値に達した全ての計算は同等であることを述べている。ゆえに、全ての計算に対して普遍的な中心的要素が存在し、その計算は、高速な部品を持つ機械の中で実行されるものでも、低速な部品であっても、あるいは生物的な脳内で発生するものであれ、まったく同一の論理的なプロセスなのである。つまりは、いかなる計算プロセス (思考) であっても、「万能」計算を実行できる機械上でエミュレートできるはずだということを意味する。シンギュラリタリアンは、この原則に依拠して、人間の心を持つシリコン製の脳をエンジニアリングできるだろうと期待している。また、この人工脳は人間と同じように思考でき、人間よりも賢くなると信じられている。この望みは懐疑的に捉えなければならないだろう。なぜならば、これはチャーチ=チューリングのテーゼの誤解に基づいているからだ。

この理論は以下のように始まる。「無限長のテープ(メモリ)と時間が与えられれば、全ての計算は同等である」 問題は、現実にはいかなるコンピュータも無限のメモリや時間を備えていないということである。現実世界におけるオペレーションでは、現実の時間が巨大な違いをもたらし、時として生と死を分かつ違いになりうる。確かに、全ての思考は同等である。もしも時間を無視するならば。確かに、人間タイプの思考はどんな基盤の上でもエミュレート可能である。ただし、時間や実世界におけるストレージやメモリの制約を無視すればである。けれども、時間を考慮に入れるならば、この原理は全く違った形で言い換える必要があるだろう。「まったく異なるプラットフォーム上で動作する2つのコンピュータシステムは、現実の時間においては同等ではない」あるいは、こうも言い換えられる。「同等の思考モードを実現する唯一の方法は、それらを同等の物質の上で動作させることである」計算を実行する物理的実体は、 -- 特に、計算が複雑になるにつれて --リアルタイムで実現可能な認知能力の種類に対して、大きな影響を与えるのだ。

この考え方を更に拡張して、人間にとてもよく似た思考プロセスを実現する唯一の方法は、極めて人間に似たウェットな組織上で計算を実行させることではないかと主張したい。また、裏を返せば、ドライなシリコン上で動作する、非常に巨大で複雑な人工知能は、巨大で複雑な、人間と似つかない心を生み出すだろうということを意味する。もしも、人間と似た形で成長するニューロンを使用する、人工のウェットな脳を製造できるとしたら、私の予想では、かなり我々に似た思考を生み出せるかもしれない。そのようなウェット脳の利点は、基盤をどれほど人間に似せて作れるかに比例するだろう。ウェットウェアを創るコストは莫大であり、ウェットウェアが人間の脳組織に近づいていくにつれて、そのコスト効率は人間を生み出す場合に近づいていく。しかし、結局のところ、人間を作ることは我々が9ヶ月間でできるではないか。*1

更には、上述の通り、我々は身体全体で考えているのであり、脳だけで考えているのではない。身体内の神経系も「理性的な」意思決定プロセス、予測や学習に影響を与えていると示す豊富なデータがある。人間の身体全体をモデル化すればするほど、それは人間の複製に近付いていくだろう。まったく異なる身体 (ウェットな炭素ではなくドライなシリコン) の中にある知能は、異なった形で考えるだろう。

これはバグではなく、特長なのだ。論点の2で議論した通り、人間とは異なる形で考えることがAIの主要な資産なのである。また、これが、AIを「人間よりも賢い」と呼ぶことがミスリーディングである理由でもある。

4.

超人的知能という概念の核心には、--特に、この知能が自己改善を続けていくという考え-- 知能は限り無いスケールを持ちうるという本質的な信念が存在している。私はこの根拠を見つけられなかった。ここでもまた、単一次元の知能量という誤った考えが、知能が無限だという信念を助長している。けれども、我々はこれが信念であると理解しなければならない。宇宙に存在するいかなる物理量も無限ではない。これまでに知られている科学的知識の範囲においては。温度は有限である。--低温にも高温にも限界がある。空間も時間も有限である。有限の速度。おそらく、数学的な数列だけは無限であるかもしれないが、それ以外の物理的属性は全て有限である。理性そのものも無限ではなく、有限であると考えるのは理にかなっている。問題は、限界はどこに存在するのだろうか? ということだ。我々は知能の限界が我々を超えたところに位置すると信じる傾向にある。我々の「上に」、ちょうど人間が蟻の「上に」位置するように。ここでも繰り返される知能が単一次元であるという誤りは脇に置くとしても、我々が限界ではないという根拠はあるのだろうか? あるいは、その限界は我々からそう遠くないところに位置するかもしれないのでは? どうして、知能は無限に拡張が続けられるものだと信じるのだろうか?

これより妥当な捉え方は、我々の知能を、100万タイプもある可能な知能の中の1つと見なす考え方だろう。つまり、それぞれの認知の次元と処理能力には限界があるものの、もしも次元数が数百種類も存在するならば、その組み合わせにより無数の種類の心が存在しうる。 -- ただし、どの次元も無限ではない。数え切れないほどの多彩な心を我々が作り、あるいは遭遇するにつれて、ごく自然にそのうちのいくつかは我々を超えていると認められるだろう。私の近著、『The Inevitable』 (〈インターネット〉の次に来るもの)では、そのような人間を超えた部分を持つ、多くの種類の心を描き出してみせた。

これら個々のエンティティを、超人的AIと呼ぼうとする人もいるだろう。しかし、これらの心のまったくの多様性と異質性は、我々に新しい語彙をもたらし、また知能と賢さに対する新しい洞察をもたらすだろう。

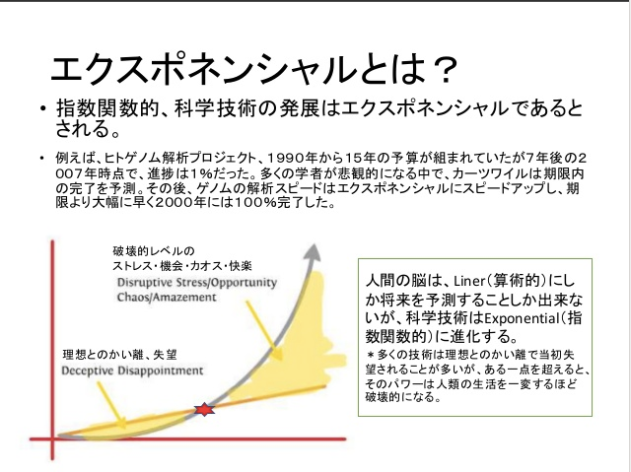

第二に、超人的AIの信者は、知能が (何かしら未定義の指標によって) 指数関数的に増加していくと仮定しているようである。おそらく、知能は既に指数関数的に増加していると仮定しているからではないかと思う。けれども、これまでのところ、知能が -- どんな方法で測定するにせよ -- 指数関数的に増加しているという根拠は無い。指数関数的な拡大とは、人工知能の能力が一定期間ごとに倍々になることを意味する。根拠はあるのだろうか? 私は何も見つけられない。もし現在そうでないのならば、なぜすぐにそうなると考えるのだろうか?指数関数的成長を遂げているものは、ただAIに対するインプットだけである。つまり、賢さや知能を生み出すために費されるリソースだ。しかし、そのアウトプットである性能は、ムーアの法則による成長には沿っていない。AIの賢さは、3年ごとに、あるいは10年ごとにさえ倍増していない。

私は多くのAIの専門家に、人工知能の能力が指数関数的な成長に沿っているのか質問した。けれども、その全員が言うには、知能を測定する指標はなく、それを棚に上げるとしても指数関数的には進んでいないのだそうだ。指数関数のウィザード、レイ・カーツワイルに、AIの成長が指数関数的であるという根拠はあるのかと私が聞いたときには、彼はAIは爆発的に増加するのではなく段階的に増加するものだと返信してきた。

「計算力とアルゴリズム複雑性の両方において指数関数的な成長が起こっており、新たなレベルの階層を付け加えている…それゆえ、新たなレベルが線形に増加していくと期待できる。というのは、新たな層を加えるためには、指数関数的な複雑性の増加が必要であるからだ。そして、我々はその能力において実際に指数関数的に進歩している。大脳新皮質の能力と比較すれば、我々はそう遠くない階層に位置している。だから、私の2029年という予測は、妥当性を失なっていないと考える。」

ここでレイが言っていることは、人工知能の能力は指数関数的に爆発しておらず、人工知能を生み出すための労力は指数関数的に爆発しているものの、アウトプットは段階的にしか増加していない、というふうに聞こえる。これは、知能が爆発しているという仮定とはほとんど正反対である。近い将来において状況が変わるかもしれないが、しかし現在、人工知能は明らかに指数関数的に増大してはいない。

それゆえ、「知能爆発」について考える際には、連鎖的な爆発ではなく、散発的な新しいバリエーションの分離として想像するべきだろう。核爆発ではなく、カンブリア爆発である。加速するテクノロジーの結果は、超人類[super-human]ではなく、追加の人類[extra-human]となるだろう。我々の経験の外にあるものの、必ずしも我々の「上」ではない。

5.

AIの支配という考え方に関して、疑問視されていないにも関わらず根拠の乏しい信念は他にもある。超人的な、無限に近い知能は、多くの未解決問題を即座に解決してしまうという信念だ。

知能爆発説の提唱者たちの多数は、知能爆発が進歩の爆発をもたらすと期待しているようだ。私はこの神秘主義的な信念を「思考主義」と呼んでいる。未来の進歩を妨げるものはただ考える力、あるいは知能のみであるという考え方は、論理的に誤りである。(また、思考力が全てを解決する魔術的な超越的要素であるという信念は、思考を好む人々が抱きがちであると指摘しておこう。)

癌を治す、あるいは寿命を伸ばすことを考えよう。これらは考えるだけで解決できる問題ではない。どれほど思考主義に頼ったとしても、どのように細胞が老化するのか、あるいはテロメアが脱落するのか知ることはできない。いかなる知能であれ、どれほど優れた知能であっても、今日世界中で出版されている全ての科学文献を読んで理解するだけでは、人間の身体がどのように機能しているか解明することはできない。どれほど優れた人工知能でも、過去と現在の核分裂実験について熟考するだけでは、1日のうちに核融合を実用化することはできない。ものごとのしくみが分からない状況から始めて、それを理解した状態に至るまでには、単なる思考以上のものが必要とされる。正しい作業仮説を打ち立てるまでには、実世界での大量の実験、そこから生み出される何トンという相矛盾したデータが必要であり、そして相矛盾したデータによって更なる実験が必要とされる。予測したデータについて考えても、正しいデータは得られない。

思考(知能)は、科学の一部にすぎない。もしかしたら、ごく小さい部分であるにすぎない。一例を挙げれば、我々は死の問題の解決に近づくことができるほどの適切なデータを十分には持っていない。生体組織を扱う場合、このような実験にはたいていカレンダー単位の時間を要する。細胞の低速な代謝は速めることができない。結果を得るためには、何年も、何か月も、少なくとも何日かは必要となる。素粒子に何が起きるのかを知りたければ、単に思考するのみでは不可能である。発見のためには、非常に大きな、非常に複雑な、非常に手の込んだ実験設備を建設しなければならない。最も優秀な物理学者が今の1000倍賢くなったとしても、コライダー(衝突型加速器)がなければ何も新しい発見はできない。

超人的AIができたとすれば、それが科学のプロセスを加速することに疑いはない。原子や細胞のコンピュータシミュレーションは実行できるし、シミュレーションはいろいろな手法を使って高速化できる。しかし、高速の進歩を成し遂げることにおいては、シミュレーションの有用性は2つの問題によって制限されている。まず、シミュレーションとモデルが実験対象よりも高速であるのは、何らかの要素を無視している場合に限られることが挙げられる。これはモデルやシミュレーションの本質的な性質である。また、モデルの実験、検証、証明には、実験対象の変化速度に合わせてやはりカレンダー単位の時間を要することも指摘しておきたい。

これらのシンプルなシミュレーションも有用であり、成功の見込みが高い方針を選び出すために役に立つ。それゆえ、進歩を加速させることができるだろう。しかし、実際のところはうまい話はない。現実のあらゆる要素が何らかの差異をもらすのだ。これは「現実」の一つの定義である。モデルとシミュレーションが詳細化されるにつれて、それらはある限界を迎えることになる。すなわち、「現実」の100パーセント完璧なシミュレーションを、現実よりも高速に動作させることはできないという限界だ。これは、「現実」の別の定義である。すなわち、ありうる全ての詳細度と自由度のうちで、最も高速なバージョンである。たとえ仮に、人間の身体のあらゆる細胞、細胞の中のあらゆる分子をモデル化できたとしても、このシミュレーションはせいぜい実際の人間の身体と同程度の速度でしか動作しないだろう。どれほど思考したとしても、なお実験の実施には時間を要する。現実のシステムであれ、シミュレーションのシステムであれ、それは変わらない。

人工知能が有用であるためには、現実世界に構築されなければならない。そして、たいていの場合、その世界がイノベーションを律速する。実験を実施し、プロトタイプを構築し、失敗を重ねて、現実に立脚していなければ、知能が思考しても結果を得ることはできない。「人間よりも賢い」AIが出現したとしても、分、時間、日、年の単位で、ただちに発見があるわけではない。AIが進歩するにつれて、発見の速度は大幅に加速するだろうことは確かである。エイリアン的なAIが、人間には思いもよらないような疑問を発するかもしれない。とは言え、(我々と比較して) 非常に強力な知能が存在したとしても、即時の進歩を意味するわけではない。問題解決には、知能以上のものが必要とされるのだ。

知能のみでは解決できない問題は、癌や寿命に限らない。知能自体もそうだろう。シンギュラリティ論者たちに共通した性質として、ひとたび「人間よりも賢い」AIが作られると、AIは一生懸命に思考し「自分自身より賢い」AIを発明する、と想像する傾向がある。そのAIは、更に一生懸命思考してもっともっと賢いAIを作り、能力が爆発的に増大し、ほとんど神のごとき存在と化すまでそれが続くのだとされている。単に知能について思考するだけで、新たなレベルの知能が創造できるという根拠はない。この種の思考主義もただの信念にすぎない。新しい種類の実用的な心を創り出すためには、膨大な量の知能に加えて、心理学の実験、データ、試行錯誤、奇妙な質疑など、単なる賢さを超えたあらゆる種類の作業が必要だと示す証拠がある。

結論として、私の主張は誤りであるかもしれないと言っておこう。人工知能の研究は未だ黎明期にある。知能の普遍的な測定方法が発見されるかもしれない。知能はあらゆる方向に無限であることが分かるかもしれない。知能が何なのか(ましてや意識が何であるか)について我々が知っていることはあまりにも少ないため、何らかの形でAIシンギュラリティが発生する可能性は、ゼロよりは大きい。私が考えるところでは、あらゆる根拠がシンギュラリティのシナリオはほとんどありえないと示していると思うものの、しかしゼロ以上ではある。

であるため、その可能性については同意しないが、OpenAIの広範な目標や、超人的AIを憂慮する知的な人々の活動には賛同する。--つまり、我々は友好的なAIをエンジニアリングする必要があり、我々の価値観に即した自己複製的な価値をAIに実装する方法を発見しなければならない。けれども、私が思うに、超人的AIが人類の存続に対する脅威となる可能性はごく低い(そして、考慮に値するものですらない)。その可能性の低さ (これまでに得られている根拠に基づいたもの) を考慮すると、シンギュラリティの可能性は、科学、政策、技術開発の指針とするべきではないと思う。地球に対する小惑星の衝突は、破滅的な被害をもたらしうるだろう。その可能性はゼロより大きい (それゆえ、B612ファウンデーション*2を支援するべきである) ものの、小惑星衝突の可能性を、たとえば、気候変動、宇宙旅行、あるいは都市計画などについての我々の努力に対して、考慮に入れるべきではない。*3

同様に、今得られる根拠に基づけば、AIが超人的存在になることはほぼないだろう。何百種類もの新種の思考が生まれ、そのほとんどは人間とは異なるものとなる。それらは汎用的なものではないし、また、一瞬にして大きな問題を解決してしまう即席の神となるわけでもない。実際には、非常にたくさんの有限の知能が表れ、未知の次元で動作することになるだろう。それらは多くの点で我々の思考を超えているかもしれないが、我々と協働しながら時間を掛けて問題を解決し、また新たな問題を創り出していくのである。

超人的AIの神という概念の美しい魅力は、私にも理解できる。それは新しいスーパーマンに似ている。けれども、それはスーパーマンと同じように、神話的な存在である。この宇宙のどこかにスーパーマンが居るかもしれないが、彼が実在する見込みはとても低い。けれども、神話は役に立つこともあるし、ひとたび考案されると消えることはない。スーパーマンの概念は決して死ぬことはない。同様に、超人的AIのシンギュラリティという概念も、既に誕生してしまったため、決して消滅することはないだろう。けれども、現状ではそれは宗教的な考えであり、科学的なものではないということは認識しなければならない。もしも、知能 (人工であれ天然であれ) について現在までに知られている根拠を精査するならば、超人的AIの神に関する我々の空想は、次のように呼ばなければならない。すなわち、神話であると。

ミクロネシアの孤立した島々においては、外部世界との最初の接触は第二次大戦中のことであった。見知らぬ神々が騒音を立てる鳥に乗って大空を飛行し、食料と物資を彼らの島々に落とし、そして二度と戻ることはなかった。もう一度神々が戻り、もっと貨物を落としてくれるようにと祈る宗教的カルトが島々に広まっていった*4。今日でさえ、50年以上も経っても、未だ多くの人がカーゴの帰りを待っている*5。超人的AIも、新たな種類のカーゴカルトであると判明するだろうと思う。今から1世紀後の人々が今の時代を振り返って見たとき、現代は新たな信仰が始まった時期とみなされるかもしれない。つまり、シンギュラリティ教徒たちが、今にも超人的AIが到来することを切望し、想像を超えた価値ある物資を授けてくれるようにと祈り出した時代だ。何十年以上もの間、信者たちは超人的AIの降臨を待っている。必ずや、すぐにでも超人的AIがカーゴを携えて到来すると信じて。

けれども、超人的ではない人工知能は既に、ここに、実際に存在している。我々はそれを再定義し、難易度を増加させるだろうが、それは未来に閉じ込められている。けれども、より広い意味でのエイリアン的知能 -- さまざまな種類の連続的スペクトラム上の賢さ、知能、認知、推論、学習や意識など -- という意味においては、AIは既にこの惑星の上に広まっている。そして、今後も拡大し、深化し、多様化し、増加していくだろう。過去のどんな発明も、世界を変える力においてAIに敵うものはあるまい。1世紀後には、AIが我々の生活全てに影響を及ぼし、作り替えていくはずだ。それでも、超人的AIの神話、我々にすさまじい繁栄もたらすか、我々にすさまじい隷属をもたらす(あるいはその両方)という想像は、これからも生き延び続けるだろう。その可能性は、あまりに神秘的すぎるために決して消え去ることはない。